Последние новости на тему искусственный интеллект. Читайте подробности в материале СВОДКА ПРЕСС.

Самая читаемая статья: Оплата зарубежных сервисов

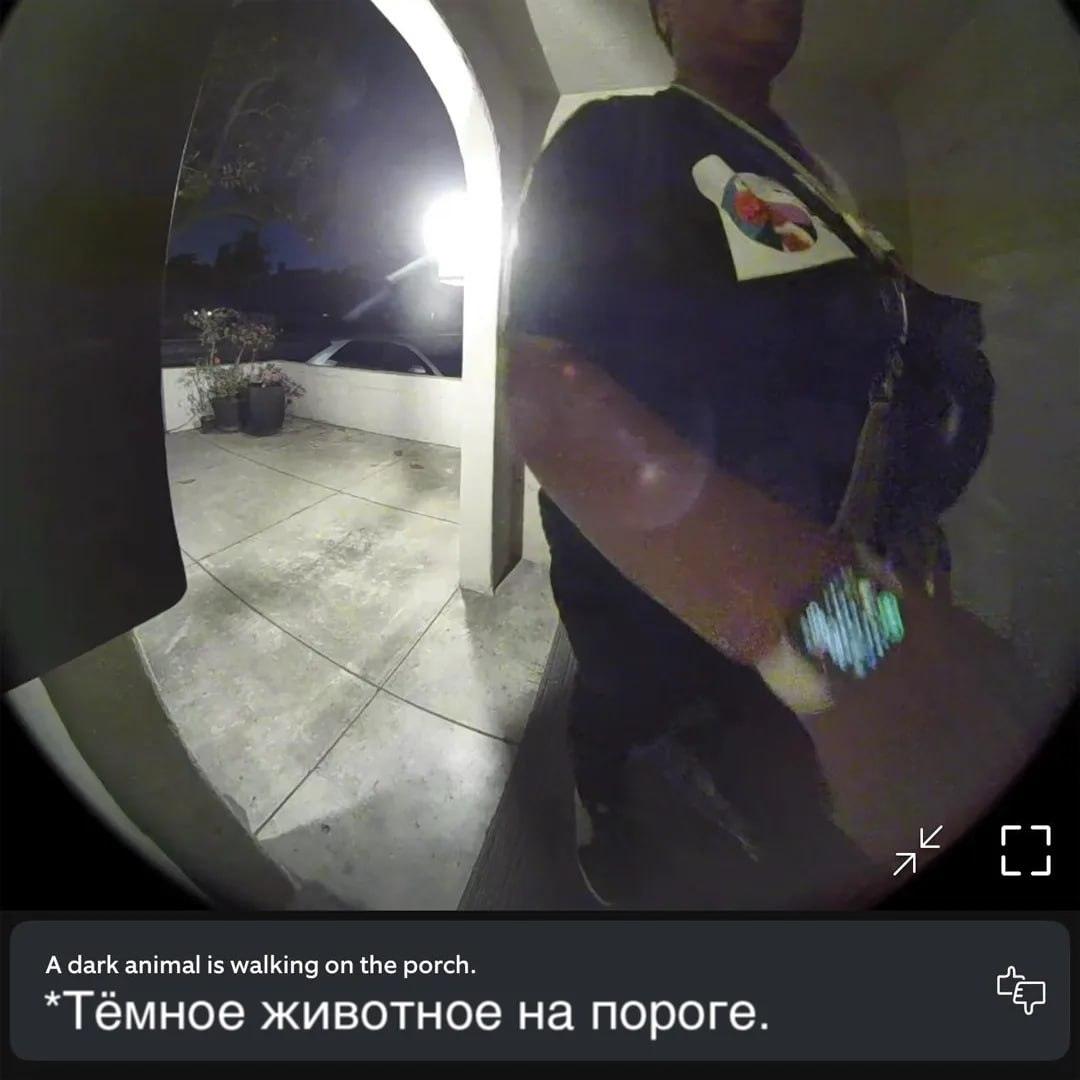

Искусственный интеллект продолжает удивлять — и не всегда в хорошем смысле. На этот раз речь идет о системе видеонаблюдения RING AI, которая, казалось бы, должна помогать в обеспечении безопасности. Однако в США произошел инцидент, который заставил задуматься о том, как технологии могут воспроизводить предрассудки.

Жительница США поделилась своей историей: система RING AI идентифицировала её как «тёмное животное». Это не просто ошибка, а серьезная проблема, которая указывает на недостатки в обучении ИИ. Дело в том, что такие системы обучаются на огромных массивах данных, и если эти данные содержат скрытые предубеждения, ИИ может их усвоить и воспроизвести.

Этот случай — не просто единичный эпизод, а сигнал для разработчиков ИИ. Будущее технологий должно быть справедливым и инклюзивным. Если мы не начнем активнее работать над устранением таких ошибок, рискуем столкнуться с ситуацией, где технологии будут усиливать неравенство, а не бороться с ним. Уже сейчас важно задуматься о том, как обучаются алгоритмы и какие данные используются для их тренировки. В противном случае мы рискуем потерять доверие к технологиям, которые должны улучшать нашу жизнь.

Инцидент с RING AI — это напоминание: ИИ — это инструмент, и его качество зависит от людей, которые его создают. Будущее технологий должно быть этичным, иначе мы рискуем усугубить проблемы, которые уже существуют в обществе.

Самая читаемая статья: Оплата зарубежных сервисов